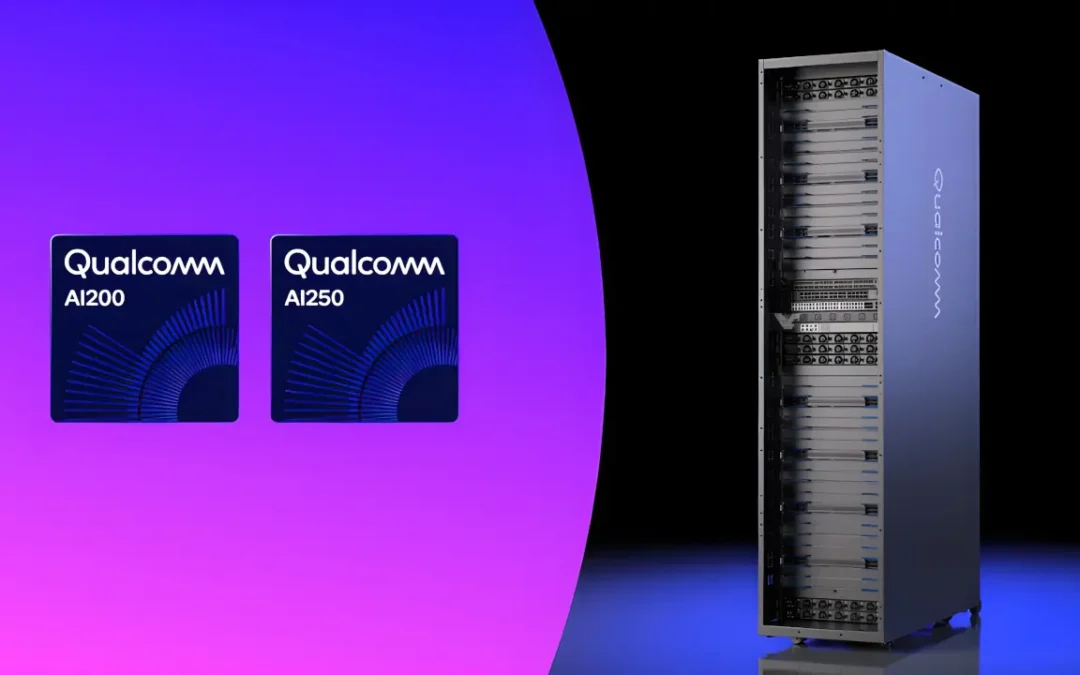

Qualcomm Rilis Akselerator AI200 & AI250: Tantang Hegemoni Inferensi Pusat Data

Infopendidikan.bic.id — Perusahaan semikonduktor raksasa Qualcomm Technologies baru saja mengambil langkah monumental dengan secara resmi meluncurkan jajaran perangkat keras akselerator kecerdasan buatan (AI) generasi terbaru mereka, yakni seri AI200 dan AI250. Peluncuran produk mutakhir ini menandai pergeseran fokus strategis perusahaan yang selama ini mendominasi pasar cip ponsel pintar, untuk kini bertarung di arena pusat data berskala masif. Dirancang secara spesifik untuk menangani beban kerja inferensi kecerdasan buatan generatif, seperti operasional chatbot tingkat lanjut dan platform sintesis gambar, kedua cip ini disiapkan untuk meluncur ke pasar komersial secara bertahap mulai tahun 2026 dan 2027.

Berdasarkan rilis resmi yang dikeluarkan oleh jajaran eksekutif Qualcomm, inovasi paling radikal dari arsitektur cip terbaru ini terletak pada kapasitas dan kecepatan akses memorinya. Seri AI200 dan AI250 menawarkan dukungan modul memori terintegrasi hingga 768 Gigabyte per kartu, sebuah angka yang luar biasa besar untuk standar industri saat ini. Lebih jauh lagi, melalui implementasi desain komputasi yang berdekatan dengan memori (near-memory computing), Qualcomm mengklaim sistem arsitektur AI250 mampu memberikan lonjakan bandwidth hingga sepuluh kali lipat lebih tinggi dibandingkan solusi konvensional. Seluruh kapabilitas teknis ini dibungkus dengan satu tujuan fundamental: menghadirkan tingkat efisiensi daya yang belum pernah ada sebelumnya di dalam ekosistem komputasi awan global.

Manuver agresif dari desainer cip yang berbasis di California ini merupakan respons langsung terhadap krisis biaya operasional yang tengah melanda industri kecerdasan buatan. Ketika adopsi model bahasa besar (Large Language Models) semakin meluas di kalangan korporat dan konsumen akhir, perusahaan penyedia layanan komputasi awan harus menanggung beban listrik dan biaya infrastruktur yang meroket tajam. Dengan berbekal rekam jejak panjang dalam mendesain prosesor hemat daya untuk perangkat bergerak, Qualcomm kini memproyeksikan keahlian efisiensi energi tersebut ke dalam skala rack server pusat data, menawarkan alternatif yang sangat menggiurkan bagi perusahaan yang tengah berupaya menekan Total Biaya Kepemilikan (Total Cost of Ownership/TCO).

Konteks Penting di Balik Fokus pada Komputasi Inferensi

Untuk memahami signifikansi dari peluncuran AI200 dan AI250 ini, kita harus melihat pergeseran fundamental yang tengah terjadi dalam siklus hidup pengembangan kecerdasan buatan. Selama setengah dekade terakhir, investasi ratusan miliar dolar di industri teknologi telah difokuskan pada fase "pelatihan" atau training model AI. Fase ini menuntut tenaga komputasi mentah yang luar biasa masif untuk mencerna triliunan keping data dari internet, sebuah segmen pasar yang sejauh ini dimonopoli hampir secara absolut oleh arsitektur GPU dari Nvidia. Namun, seiring dengan semakin matangnya model-model fundamental tersebut, industri kini memasuki fase kedua yang memiliki skala ekonomi jauh lebih masif, yaitu fase inferensi.

Inferensi adalah proses eksekusi di mana model kecerdasan buatan yang sudah terlatih mulai bekerja melayani miliaran permintaan pengguna secara aktual setiap detiknya. Berbeda dengan pelatihan yang dilakukan dalam siklus waktu tertentu, beban kerja inferensi berjalan tanpa henti selama dua puluh empat jam penuh. Setiap kali seorang pengguna meminta ringkasan dokumen hukum, menerjemahkan percakapan secara real-time, atau menghasilkan karya seni digital melalui perintah teks, peladen di pusat data harus melakukan kalkulasi inferensi. Menggunakan cip grafis raksasa yang dirancang untuk pelatihan guna mengeksekusi tugas inferensi ini sering kali diibaratkan seperti menggunakan truk kontainer hanya untuk mengantar sebuah parsel kecil; sangat tidak efisien dan menghabiskan daya listrik secara percuma.

Di sinilah letak strategi utama Qualcomm. Ali-alih mencoba menantang dominasi absolut Nvidia di ranah pelatihan model, perusahaan memilih untuk melakukan intervensi bedah pada segmen inferensi yang jauh lebih sensitif terhadap margin biaya operasional. Ekosistem pusat data global saat ini tengah menjerit menghadapi lonjakan tagihan listrik dan keterbatasan kapasitas termal pendingin ruangan. Dengan merancang akselerator yang secara genetik memang dikondisikan untuk mengonsumsi daya dalam jumlah konservatif namun dengan output respons yang seketika, Qualcomm menawarkan jalan keluar dari leher botol ekonomi yang menghantui masa depan komersialisasi kecerdasan buatan generatif.

Arsitektur Memori Pendobrak Kebuntuan Kinerja

Salah satu sorotan teknis paling krusial dari pengumuman ini adalah pendekatan inkonvensional Qualcomm terhadap desain memori. Dalam arsitektur komputasi kecerdasan buatan, prosesor sekuat apapun akan lumpuh jika data yang harus diolah tidak tiba tepat waktu. Fenomena antrean data ini dikenal di industri sebagai "dinding memori" (memory wall). Untuk mengatasi kebuntuan ini, kebanyakan pesaing berlomba-lomba menggunakan teknologi High Bandwidth Memory (HBM) yang ditumpuk secara vertikal. Namun, Qualcomm memilih rute yang berbeda dengan memanfaatkan keahlian mereka memodifikasi standar Low-Power Double Data Rate (LPDDR), yang secara historis merupakan tulang punggung perangkat seluler modern.

Kapasitas raksasa 768 GB per kartu yang ditanamkan pada seri AI200 dan AI250 memberikan keunggulan asimetris dalam menangani konteks data yang luar biasa luas. Dalam operasional aplikasi chatbot tingkat korporasi atau sistem analisis dokumen hukum, model AI perlu mengingat puluhan ribu hingga ratusan ribu kata sekaligus sebelum memberikan jawaban yang koheren. Semakin besar kapasitas memori tunggal di dalam sebuah cip, semakin jarang cip tersebut harus meminta data dari komponen penyimpanan eksternal yang lambat. Hal ini secara langsung menghilangkan jeda waktu tunda (latency) yang sering kali mengganggu kenyamanan interaksi pengguna dengan agen kecerdasan buatan.

Lebih jauh lagi, lompatan arsitektural sejati dijanjikan pada model AI250 melalui konsep komputasi dekat memori. Secara teknis, arsitektur ini memindahkan sebagian unit logika pemrosesan secara fisik sedekat mungkin ke area penyimpanan data sementara. Alih-alih memindahkan data berukuran gigabyte bolak-balik melintasi sirkuit papan induk untuk diproses, instruksi komputasi justru dikirimkan ke lokasi di mana data itu bersemayam. Pembalikan paradigma inilah yang memungkinkan Qualcomm mengklaim peningkatan efisiensi bandwidth hingga sepuluh kali lipat, sembari secara bersamaan memangkas drastis daya listrik yang biasanya terbuang percuma hanya untuk pergerakan data mekanis di dalam komponen silikon.

Rincian Kritis yang Masih Ditunggu Publik

Meskipun presentasi spesifikasi makro dari AI200 dan AI250 ini berhasil memukau para pengamat infrastruktur, hingga saat ini belum ada rincian teknis mendalam yang dirilis secara resmi oleh Qualcomm terkait anatomi internal cip tersebut. Publik dan analis industri masih menantikan kejelasan mengenai spesifikasi litografi atau ukuran fabrikasi semikonduktor dalam satuan nanometer yang akan digunakan untuk mencetak cip ini. Kekosongan informasi mengenai mitra peleburan (foundry)—apakah akan mengandalkan fasilitas mutakhir TSMC atau beralih ke Samsung—meninggalkan tanda tanya besar mengenai kemampuan Qualcomm mengamankan rantai pasok global di tengah kelangkaan kapasitas produksi silikon tingkat lanjut.

Selain masalah arsitektur cetak, patokan harga komersial untuk konfigurasi tingkat rack ini juga merupakan informasi vital yang masih ditunggu oleh pasar. Tanpa adanya struktur harga yang transparan, para penyedia layanan komputasi awan hyperscaler kesulitan untuk menyusun model kalkulasi Total Biaya Kepemilikan (TCO) secara presisi jika dibandingkan dengan perangkat keras milik pesaing. Kemampuan Qualcomm untuk mendisrupsi pasar akan sangat bergantung pada seberapa agresif mereka berani memposisikan harga produk ini di bawah standar rata-rata industri yang saat ini didikte oleh dominasi pemain lama.

Kekurangan detail operasional juga terlihat pada aspek ekosistem perangkat lunak yang menjembatani cip ini dengan para pengembang aplikasi. Meskipun Qualcomm menyatakan dukungan terhadap kerangka kerja mesin pembelajaran populer, hingga pertengahan kuartal ini belum ada rilis resmi mengenai angka tolok ukur (benchmark) riil yang dikonfirmasi oleh lembaga independen pihak ketiga. Para arsitek pusat data secara tradisional sangat enggan bermigrasi ke perangkat keras baru tanpa adanya jaminan absolut bahwa tumpukan kode kecerdasan buatan mereka dapat dieksekusi tanpa memerlukan penulisan ulang ribuan baris instruksi komputasi. Integrasi perangkat lunak tanpa hambatan ini adalah teka-teki terakhir yang belum dijawab sepenuhnya oleh manajemen Qualcomm.

Menakar Ulang Standar Infrastruktur Pusat Data

Inisiatif Qualcomm untuk merangsek masuk ke segmen pusat data tidak hanya berdampak pada peta persaingan silikon, tetapi juga memaksa perancangan ulang standar bangunan fasilitas penyedia komputasi awan. Berdasarkan pernyataan teknis perusahaan, sistem akselerator ini ditawarkan dalam bentuk rak terkonfigurasi dengan batasan konsumsi daya maksimal 160 kilowatt per rak. Angka kepadatan energi yang ekstrem ini memaksa infrastruktur untuk sepenuhnya bergantung pada sistem pendingin cairan langsung (direct liquid cooling), meninggalkan era sistem pendingin udara berbasis kipas raksasa yang selama puluhan tahun menjadi tulang punggung pengelolaan termal pusat data konvensional.

Keputusan desain ini merupakan indikasi kuat bahwa masa depan fasilitas komputasi kecerdasan buatan tidak bisa lagi diakomodasi oleh gedung-gedung pusat data warisan masa lalu. Untuk menyerap kapasitas komputasi masif yang ditawarkan oleh seri AI200 dan AI250, operator infrastruktur harus merestrukturisasi sistem pemipaan internal mereka untuk mengalirkan cairan pendingin termal langsung menyentuh lempeng tembaga di atas prosesor. Meskipun investasi modal awal untuk modifikasi pendingin cairan ini sangat tinggi, efisiensi termal yang dihasilkan dalam jangka panjang adalah satu-satunya solusi logis untuk mencegah peladen-peladen modern ini terbakar akibat panas buangan yang dihasilkan dari pemrosesan triliunan operasi matematika per detik.

Penyertaan fitur komputasi konfidensial (confidential computing) di dalam perangkat keras rak ini juga memberikan lapisan asuransi yang krusial bagi pelanggan level institusi. Seiring dengan semakin seringnya lembaga perbankan, fasilitas perawatan kesehatan, dan institusi pertahanan negara menggunakan model kecerdasan buatan generatif, pelindungan data privasi tidak lagi bisa hanya diserahkan pada enkripsi tingkat perangkat lunak. Akselerator baru Qualcomm ini mengisolasi proses data di dalam ruang silikon yang tertutup secara arsitektural, memastikan bahwa bahkan penyedia layanan pusat data sekalipun tidak memiliki akses untuk mengintip algoritma atau data mentah milik klien yang sedang diproses.

Implikasi Ekosistem dan Redefinisi Masa Depan AI

Manuver strategis yang dilakukan Qualcomm melalui peluncuran ini merepresentasikan sebuah turbulensi positif yang sudah lama ditunggu-tunggu oleh ekosistem ekonomi kecerdasan buatan. Apabila seri AI200 dan khususnya AI250 terbukti mampu merealisasikan klaim efisiensi radikal yang dipresentasikan di atas kertas ke dalam operasional dunia nyata, lanskap komputasi awan akan mengalami demokratisasi gelombang kedua. Dengan biaya inferensi yang terpangkas drastis, ratusan ribu perusahaan rintisan di bidang teknologi akan memiliki kemampuan ekonomi untuk mengoperasikan model AI berskala masif, yang selama ini hak eksklusifnya hanya dikuasai oleh segelintir perusahaan teknologi bernilai triliunan dolar.

Ke depannya, kehadiran perangkat keras semacam ini akan secara fundamental mengubah cara para ilmuwan komputer mengoptimalkan algoritma mereka. Paradigma pengembangan yang selama bertahun-tahun hanya terobsesi pada pencapaian akurasi maksimal terlepas dari berapapun daya listrik yang dihabiskan, kini akan dipaksa beralih menuju orientasi desain yang seimbang antara rasio kecerdasan dan efisiensi konsumsi daya. Ketersediaan memori raksasa dengan jalur bandwidth yang lebar juga akan mempercepat lahirnya generasi baru dari sistem AI yang tidak hanya sekadar bisa merespons teks, melainkan mampu mencerna dan menyintesis data video berdurasi panjang dan simulasi tiga dimensi secara real-time tanpa jeda yang menyiksa.

Pada akhirnya, peluncuran akselerator AI Qualcomm ini lebih dari sekadar perkenalan produk perangkat keras; ini adalah proklamasi bahwa arena perang sesungguhnya di era kecerdasan buatan baru saja dimulai. Perusahaan teknologi tidak akan lagi dinilai hanya dari seberapa canggih cip mereka diuji di dalam laboratorium tertutup, tetapi dari seberapa rasional dan ramah lingkungannya cip tersebut ketika harus mendinginkan jutaan server di dunia nyata. Pemain yang mampu menaklukkan hukum termodinamika sekaligus menguasai kerumitan matematika algoritma generatif adalah pihak yang pada akhirnya akan mendikte arah evolusi peradaban digital kita di dekade mendatang.