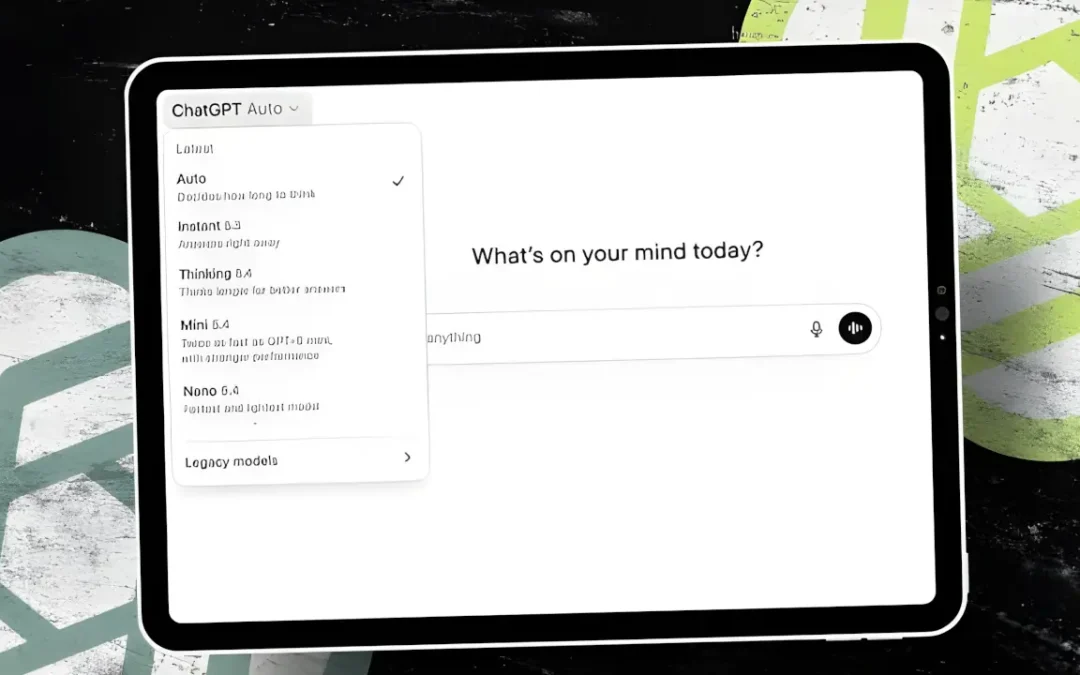

GPT-5.4 Mini: Lebih Cepat dan Ringan, Tapi Tak Semudah Memilihnya

OpenAI mulai menggulirkan GPT-5.4 mini di ChatGPT sejak 18 Maret 2026 dengan menghadirkan GPT-5.4 mini. Publikasi resmi menyebutnya sebagai model yang lebih ringan dan cepat, tersedia untuk pengguna Free dan tier Go melalui fitur "Thinking". Namun,-label "mini" dalam konteks GPT-5.4 bukan sekadar penanda ukuran. Ia adalah fondasi dari sistem baru yang lebih kompleks—sebuah lapisan cadangan yang secara otomatis mengambil alih ketika pengguna berbayar mencapai batas tarif pada model unggulan GPT-5.4 Thinking.

Keputusan untuk menghentikan layanan GPT-5 Thinking mini dalam waktu 30 hari ke depan menambah teka-teki. Apa yang sebenarnya terjadi di balik layar? Mengapa sebuah model yang baru diluncurkan langsung menggantikan model "mini" sebelumnya? Untuk memahami dampaknya, kita perlu melihat lebih dalam dari sekadar angka kecepatan respons. Ada perubahan arsitektur, strategi alokasi sumber daya, dan implikasi ekonomi yang perlu diurai.

Distilasi Penalaran: Bagaimana "Thinking" Bekerja pada Model Mini

Ada asumsi umum bahwa model "mini" hanyalah versi yang "dibodohi" dari model besar. Namun, dalam konteks GPT-5.4 mini, asumsi ini tidak sepenuhnya tepat. Komponen kunci dari model ini adalah integrasinya dengan fitur "Thinking"—sebuah fitur yang sebelumnya eksklusif pada model berparameter besar karena membutuhkan daya komputasi tinggi untuk Chain of Thought (CoT).

GPT-5.4 mini kemungkinan besar menggunakan teknik distilasi (penyulingan) lanjutan. Alih-alih memangkas parameter secara acak, OpenAI melatih model mini ini menggunakan "pikiran" atau jejak penalaran dari model besar (GPT-5.4 Thinking). Hasilnya adalah model yang tidak hanya memprediksi token berikutnya, tetapi juga meniru pola penalaran model besarnya dengan jumlah parameter yang jauh lebih sedikit.

Secara teknis, ini memungkinkan GPT-5.4 mini memberikan jawaban yang logis untuk tugas-tugas umum dengan latensi (waktu tunda) yang sangat rendah. Pengguna akan merasakan percepatan signifikan. Namun, ada batasnya. Dalam tugas yang membutuhkan penalaran multi-langkah yang kompleks atau logika abstrak yang belum pernah dilihat sebelumnya, GPT-5.4 mini mungkin akan menghasilkan hallucination (halusinasi) yang lebih halus karena ia "menghafal" pola penalaran tanpa benar-benar memiliki kapasitas untuk memverifikasi kebenarannya. Ini adalah taruhan besar OpenAI: mengorbankan kedalaman pemikiran ekstrem demi kecepatan akses bagi massa.

Mekanisme Fallback: Transisi Tak Kasat Mata dari Premium ke Standar

Salah satu aspek paling krusial namun minim sorotan adalah fungsi GPT-5.4 mini sebagai fallback atau cadangan bagi pengguna tier "Go" atau berbayar. Mekanisme ini menciptakan pengalaman pengguna yang transparan namun berpotensi membingungkan.

Bayangkan seorang pengguna berbayar sedang mengerjakan analisis data mendalam menggunakan GPT-5.4 Thinking. Saat mereka mendekati batas penggunaan (rate limit), sistem secara mulus beralih ke GPT-5.4 mini. Transisi ini seringkali tidak disertai peringatan keras di antarmuka pengguna. Pengguna mungkin melanjutkan percakapan, bertanya-tanya mengapa tiba-tiba jawaban AI terasa lebih singkat, kurang bernuansa, atau terlalu cepat.

Ini adalah blind spot baru dalam pengalaman pengguna. Di masa lalu, ketika batas tercapai, pengguna akan menemui pesan error atau permintaan untuk upgrade. Kini, layanan terus berjalan, tetapi kualitas "otak" di baliknya berubah. Bagi pengguna yang tidak peka terhadap nuansa gaya penulisan AI, hal ini bisa berakibat fatal. Keputusan bisnis atau kreativitas yang dibuat berdasarkan output model "mini" yang seharusnya ditangani model "Thinking" bisa jadi tidak optimal. Hal ini menempatkan tanggung jawab baru pada pengguna untuk selalu waspada terhadap perubahan kecepatan respons sebagai indikator kualitas model.

Ekonomi Token dan Strategi Marjin OpenAI

Peluncuran model ini bukan sekadar soal teknologi, melainkan hitungan ekonomi yang presisi. Menjalankan model seperti GPT-5.4 Thinking (model besar) sangat mahal. Setiap inference menyita memori GPU yang besar. Dengan meluncurkan GPT-5.4 mini, OpenAI sebenarnya sedang mengoptimalkan margin keuntungan mereka.

Model mini membutuhkan sumber daya komputasi yang jauh lebih kecil. Dengan menjadikannya model default bagi pengguna gratis dan cadangan bagi pengguna berbayar, OpenAI secara efektif mengurangi beban server mereka. Inilah alasan mengapa GPT-5 Thinking mini (versi lama) dihentikan. Model lama tersebut mungkin masih terlalu "berat" untuk dikategorikan sebagai model ringan, atau arsitekturnya tidak seefisien GPT-5.4 mini.

Strategi ini juga mendorong penggunaan "Go" tier. Pengguna gratis mendapatkan akses ke teknologi canggih (fitur Thinking) dengan batasan yang ketat, namun tetap membebani server. Dengan GPT-5.4 mini, OpenAI memberi "cicipan" kecerdasan tinggi tanpa harus membayar biaya operasional penuh. Ini adalah langkah cerdas: memenuhi janji "AI untuk semua" sembari menjaga struktur biasa tetap sehat. Bagi investor, ini adalah sinyal positif bahwa OpenAI serius dalam efisiensi operasional.

Dilema Pengembang: Ketika Stabilitas Menjadi Komoditas Langka

Bagi komunitas pengembang dan startup yang membangun aplikasi di atas API OpenAI (yang biasanya mengikuti siklus rilis model ChatGPT), pergantian model ini membawa tantangan tersendiri. Pengumuman bahwa GPT-5 Thinking mini akan dihentikan dalam 30 hari memberikan jendela waktu yang sangat sempit untuk migrasi.

Pengembang sering kali membangun prompt (perintah) yang sangat spesifik untuk satu model. Perubahan arsitektur dari "Thinking mini" ke "5.4 mini", meski terdengar kecil, bisa mengubah pola output secara drastis. Nuansa gaya bahasa, format markdown, atau cara model merangkai argumen bisa berubah.

Lebih jauh lagi, adanya mekanisme fallback pada antarmuka ChatGPT tidak serta merta berlaku pada API. Pengembang harus menulis ulang logika aplikasi mereka untuk menangani kemungkinan rate limit atau peralihan model manual. Ketidakpastian siklus hidup model ini (sebuah model hanya bertahan beberapa bulan sebelum diganti) memaksa pengembang untuk terus menerus melakukan iterasi, bukan pada fitur produk mereka, melainkan pada fondasi AI yang mereka gunakan. Hal ini memukuhkan dominasi OpenAI sebagai pihak yang mengendalikan "aturan main", di mana pengembang harus beradaptasi atau tertinggal.

Nasib Pengguna Loyal: Penghentian Model Tanpa Pesan Bunga

Ada sentimen nostalgia dan fungsional dalam penghentian GPT-5 Thinking mini. Dalam dunia AI, model yang lebih lama seringkali memiliki "kepribadian" atau karakteristik tertentu yang disukai pengguna. Mungkin GPT-5 Thinking mini lebih sederhana, lebih langsung, atau kurang "beretika" dibanding model baru yang sangat dibatasi oleh safety guardrails.

Penghentian model ini menandai sebuah realitas pahit dalam konsumsi AI modern: pengguna tidak memiliki kepemilikan atas alat yang mereka gunakan. Berbeda dengan membeli buku atau software versi lama yang bisa disimpan selamanya, model AI bersifat fana. Pengguna yang telah terbiasa dengan ritme dan gaya GPT-5 Thinking mini kini dipaksa untuk beralih. Bagi sebagian pengguna, ini adalah penurunan kualitas jika GPT-5.4 mini terlalu "dioptimalkan" untuk kecepatan, sehingga kehilangan "jiwa" dari pendahulunya.

Menuju AI Dinamis dan Tidak Pasti

Ke depannya, kehadiran GPT-5.4 mini dan strategi peluncurannya adalah pelopor menuju era "AI Dinamis". Kita akan melihat sistem yang semakin cair, di mana nama model di menu dropdown hanyalah label dari serangkaian proses kompleks di backend.

Pengguna mungkin tidak lagi tahu persis model mana yang sedang mereka gunakan. Sistem routing canggih akan mengarahkan pertanyaan sederhana ke model mini super cepat, dan pertanyaan kompleks ke model besar. Ini efisien, namun juga menciptakan ketidakpastian. Bagaimana jika model salah mengkategorikan kompleksitas pertanyaan?

Selain itu, strategi ini memperlihatkan bahwa OpenAI sedang mempersiapkan infrastruktur untuk perangkat mobile dan IoT (Internet of Things). Model mini yang cepat dan ringan adalah kunci untuk menjalankan AI di perangkat dengan daya komputasi terbatas (on-device atau hybrid). GPT-5.4 mini mungkin adalah langkah persiapan menuju ChatGPT yang benar-benar terintegrasi dalam sistem operasi smartphone atau asisten rumah tangga, di mana latensi harus minimal.

Membaca Antara Baris Kode

Rilisnya GPT-5.4 mini bukan sekadar penambahan item baru di daftar menu ChatGPT. Ia adalah manifestasi dari kompromi yang harus dibuat dalam skala besar: antara kedalaman penalaran dan kecepatan akses, antara biaya operasional dan pengalaman pengguna.

Bagi pengguna biasa, ini adalah kabar baik—akses ke fitur "Thinking" menjadi lebih luas. Namun, bagi pengguna industri, pengembang, dan profesional yang mengandalkan konsistensi, adaptasi adalah kata kunci utama. Peralihan model yang cepat dan mekanisme fallback yang tak kasat mata mengingatkan kita bahwa AI generatif masih dalam fase pertumbuhan yang eksplosif. Kita tidak sedang menggunakan produk jadi yang final, melainkan layanan yang terus berevolusi, berubah, dan terkadang meninggalkan kita di tengah jalan ketika satu model mencapai akhir hayatnya. Memahami GPT-5.4 mini berarti memahami bahwa di era ini, fleksibilitas adalah satu-satunya kepastian.